在开源项目方面,LinkedIn一直在为全世界的数据工作者做出贡献。近日,为了提高开发人员的Hadoop和spark工作效率,LinkedIn再次做出贡献,开源了其一款工具“大象医生(Dr.elephant)”。

Hadoop这只象需要帮助

Hadoop的标志是一只黄色的小象,这也是LinkedIn这款工具名字的源来所在。“大象医生”是LinkedIn推出的一款Hadoop和Spark性能调节工具。根据LinkedIn软件工程师Akshay Rai在其微博中的介绍,这款工具将更好的帮助用户理解、分析并提高他们的工作效率。

Hadoop是在大数据浪潮中催生的一个强大的分布式系统开源软件基础构架,其常常被用于开发分布式程序,利用集群进行高速本地计算和存储服务。Hadoop以一种一种可靠、高效、可伸缩的方式进行数据处理,并且依赖于社区服务,成本较低,因此至今火爆非常。

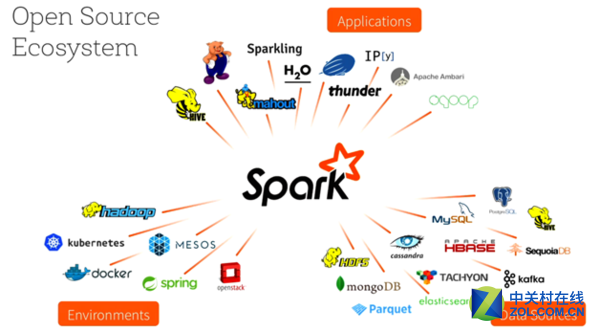

而Spark则是一种与Hadoop相似的开源集群计算环境,但是相比Hadoop,spark在工作负载方面的表现更为优越,也被认为是未来取代Hadoop的关键。但实际上,spark是一种对Hadoop的补充,可用来构建大型、低延迟数据分析应用程序。

Hadoop和Spark在开源数据分析处理中占据着举足轻重的地位。作为大数据行业的先行者,LinkedIn对此两款软件的依赖也非常严重。LinkedIn每天运行约10000 Hadoop和Spark工作。而且随着公司业务的增长,Hadoop和Spark被应用于更多的数据分析业务。因此,开发一款可以提高工作效率的工具也就成了必要的事情。

当利用Hadoop完成大量的分布式存储和大数据集的处理时,多个组件之间的相互作用就变得尤为重要。因此,LinkedIn开发这款工具的目的就是要确保每个组件的执行,并进行相关的优化。

贴切用户的名医

大象医生这款工具可以优化底层硬件资源、网络基础设施、操作系统和其他的组件,这一系列的优化设施会帮助用户更好的控制在集群上运行的工作。

大象医生这款工具很好的帮助提升了Hadoop的作业运营指标,通过分析和介绍帮助用户能够采用一种更为简洁的方法搭建构架。该工具也使得Hadoop的工作变的更容易调整,降低开发难度,提升开发人员的生产力,提高集群工作效率。