GPU是什么,相信不用笔者多加解释,但是你可能不知道,如今很多人工智能技术都在使用一台服务器搭载多个GPU的方式。根据外媒报道,近日,IBM 发布了一种结合软件和硬件的新型分布式系统PowerAI DDL,该系统不仅在Imagenet 22K任务上实现了当前最佳的性能,同时还只需要7小时就能完成训练,具备多个GPU的多个服务器上扩展。

根据IBM介绍:我们软件可以完全同步地进行深度学习训练,并且这种训练只有非常少的通信成本。因此,当我们将该系统扩展到有100多个英伟达GPU的大型计算机集群时,它在ImageNet-22K数据集上的7.5M图片上识别精度达到了33.8%,而前面最好的结果是微软实现的29.8%。

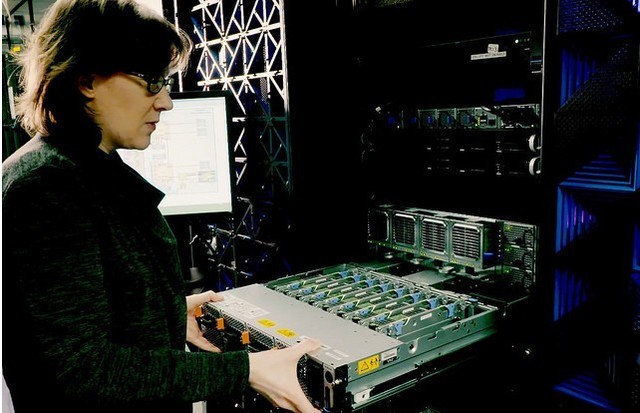

之前,256块GPU的最佳扩展来自Facebook人工智能研究院(FAIR)的一个团队。FAIR使用了一个较小的深度学习模型ResNet-50,和一个较小的大约130万张图像的数据集ImageNet-1K;二者降低了计算复杂度,并使用较大的8192的批量大小;最终,通过Caffe2在256块英伟达P100 GPU加速集群上取得了89%的扩展效率。对于一个ResNet-50模型和一个与Facebook相同的数据集,IBM Research DDL通过Caffe实现了95%的效率,如下表所示。这是在64台“Minsky”Power S822LC系统的集群上运行的,每个系统有4块英伟达P100 GPU。

IBM此次试验再次打破了世界纪录,让深度学习得以走向一个更准确、快捷的训练方式。不知道这种方法未来是否会与专注智慧医疗的IBM沃森合作,打造更人性化、专业化的解决方案。